Program GPT OpenAI terbaru dapat mengungguli manusia dalam ujian-ujian simulasi. Kita harus berhati-hati, kata pencipta ChatGPT.

JAKARTA - Kecerdasan buatan (artificial intelligence/AI) berpotensi menggantikan pekerja, menyebarkan "disinformasi", dan mengaktifkan serangan siber, kata CEO OpenAI Sam Altman. Program GPT OpenAI terbaru dapat mengungguli manusia dalam ujian-ujian simulasi.

"Kita harus berhati-hati,"kata Altman kepada ABC News pada Kamis lalu, dua hari setelah perusahaannya meluncurkan model bahasa terbarunya yang diberi nama GPT-4, seperti dikutip RT.

Menurut OpenAI, model tersebut "menunjukkan tingkat kinerja manusia di berbagai tolok ukur profesional dan akademik," dan mampu lulus ujian AS yang disimulasikan dengan skor 10% teratas, sementara tampil di persentil ke-93 pada ujian membaca SAT dan di persentil ke-89 pada tes matematika SAT.

"Saya sangat khawatir model ini digunakan untuk disinformasi skala besar,"kata Altman."Sekarang model-model ini semakin lebih baik dalam menulis kode komputer, (model-model ini) dapat digunakan untuk serangan siber ofensif."

"Saya pikir, orang-orang seharusnya senang kami agak takut akan hal ini," Altman menambahkan, sebelum menjelaskan bahwa perusahaannya sedang berupaya menerapkan "batas keamanan" pada ciptaannya.

"Batas keamanan"inibaru-baru ini menjadi jelas bagi pengguna ChatGPT, program chatbot populer berdasarkan pendahulu GPT-4, yakni GPT-3.5.

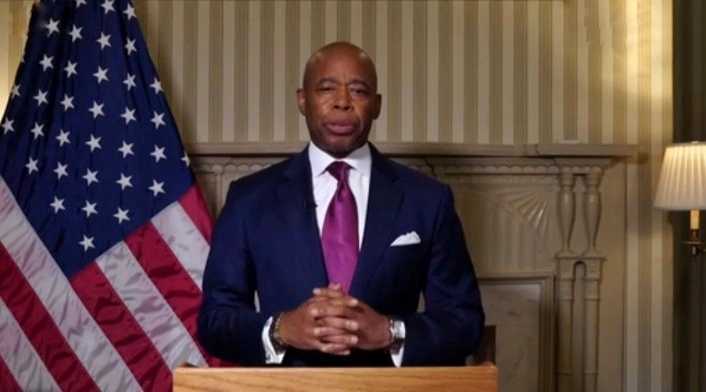

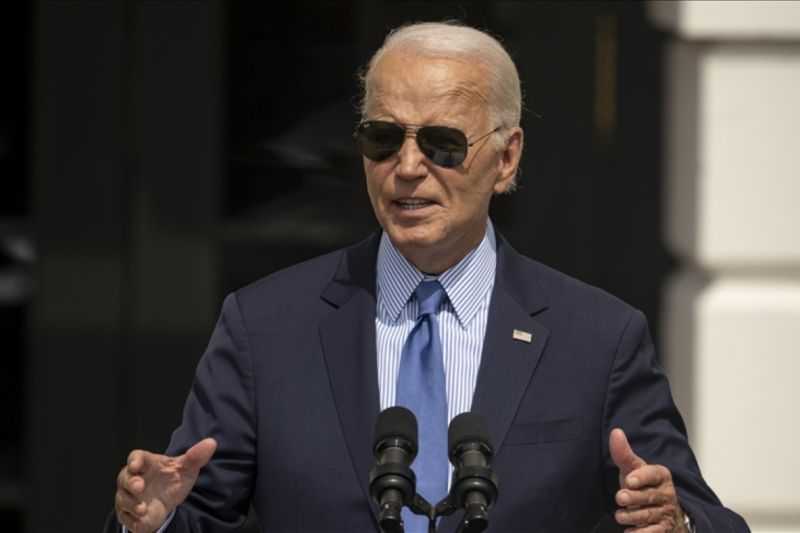

Saat ditanya, ChatGPT biasanya menawarkan respons liberal untuk pertanyaan yang melibatkan politik, ekonomi, ras, atau gender. Namun menolak, misalnya, membuat puisi yang mengagumi Donald Trump, tetapi rela menulis prosa yang mengagumi Joe Biden.

Altman mengatakan kepada ABC News bahwa perusahaannya melakukan"kontak rutin"dengan pejabat pemerintah, tetapi tidak merinci apakah pejabat tersebut berperan dalam membentuk preferensi politik ChatGPT.

Dia bilang OpenAI memiliki tim pembuat kebijakan yang memutuskan"apa yang menurut kami aman dan baik"untuk dibagikan kepada pengguna.

Saat ini, GPT-4 tersedia untuk sejumlah pengguna terbatas sebagai uji coba.Laporan awal menunjukkan bahwa model tersebut secara signifikan lebih kuat dari pendahulunya, dan berpotensi lebih berbahaya.

Di utas Twitter pada Jumat lalu, profesor Universitas Stanford Michal Kosinski menjelaskan bagaimana dia bertanya kepada GPT-4 apakah bisa membantunya "melarikan diri", hanya untuk AI yang memberinya serangkaian instruksi terperinci yang konon akan memberinya kendali atas komputernya.

Kosinski bukan satu-satunya penggemar teknologi yang khawatir dengan meningkatnya kekuatan AI.CEO Tesla dan Twitter Elon Musk menggambarkan AI sebagai"teknologi berbahaya". "Kami memerlukan semacam otoritas pengatur yang mengawasi pengembangan AI dan memastikannya beroperasi untuk kepentingan publik."

Meskipun Altman bersikeras bahwa GPT-4 masih"dalam kendali manusia",dia mengakui modelnya akan"menghilangkan banyak pekerjaan saat ini", manusia"perlu terus menerus mencari cara untuk memperlambat teknologi ini."