Indonesia Kembangkan AI Generatif Lokal, Ada Keuntungan dan Risiko di Baliknya

- Kecerdasan Buatan

- Artificial Intelligence (AI)

- AI Generatif

Albert Jehoshua Rapha, KU Leuven

Ket. Ilustrasi Large Language Models atau LLM - sistem kecerdasan buatan yang mampu memahami dan menghasilkan bahasa seperti manusia berdasarkan pelatihan model bahasa besar.

Doc: The Conversation/Shutterstock/Ole CNXKebanyakan dari kita mungkin sudah cukup familier dan sering menggunakan ChatGPT- aplikasi kecerdasan buatan yang dikembangkan oleh OpenAI, sebuah perusahaan yang berbasis di San Francisco, Amerika Serikat.

ChatGPT merupakan salah satu contoh generative artificial intelligence atau Gen AI yang dilatih dengan model bahasa besar atau large language model (LLM). Model ini menggunakan arsitektur generative pre-trained transformer (GPT) yang memungkinkan hasil teks yang sangat alami dan menyerupai bahasa manusia.

Sederhananya, LLM bisa kita sebut dengan model kecerdasan buatan berbasis bahasa atau AI berbasis teks.

Saat ini, Indonesia tengah mengembangkan AI dengan model serupa. Bedanya, model yang dikembangkan saat ini berfokus pada pemahaman dan penggunaan bahasa Indonesia serta bahasa lokal yang kaya dan beragam. Artinya, alat ini akan lebih relevan dan kontekstual untuk masyarakat Indonesia, sekaligus mengatasi tantangan yang mungkin dihadapi oleh model-model kecerdasan buatan dari luar ketika berinteraksi dalam bahasa dan budaya lokal.

Inisiatif AI berbasis bahasa di Indonesia

Ada tiga inisiatif penting yang diluncurkan dalam pengembangan AI berbasis bahasa di Indonesia baru-baru ini, yakni:

Anda mungkin tertarik:

1. Kolaborasi KORIKA dan AI Singapore: Indonesia melalui Badan Riset dan Inovasi Nasional (BRIN) dan Kolaborasi Riset dan Inovasi Industri Kecerdasan Buatan (KORIKA) bekerja sama dengan AI Singapore dalam pengembangan platform Southeast Asian Languages In One Network atau SEA-LION, yang dirancang untuk memperkuat kemampuan AI dalam bahasa-bahasa Asia Tenggara, termasuk bahasa Indonesia.

2. Komodo-7B: Model bahasa besar yang dikembangkan oleh Yellow.AI dirancang untuk mendukung berbagai aplikasi termasuk pemrosesan bahasa alami atau natural language processing (NLP). Model ini fokus pada interaksi dalam bahasa Indonesia serta beberapa dialek lokal.

3. Proyek Garuda: Proyek ini dikembangkan oleh Indosat Ooredoo Hutchison (IOH) dan Tech Mahindra. Fokusnya adalah melestarikan bahasa Indonesia dan dialek-dialek lokal melalui LLM. Garuda akan dikembangkan dengan 16 miliar token asli Indonesia, menyediakan 1,2 miliar parameter untuk membentuk pemahaman model terhadap bahasa Indonesia.

Perkembangan ini menempatkan Indonesia sebagai negara kedua di Asia Tenggara-setelah Singapura-dalam arena LLM. Langkah ini penting untuk meningkatkan representasi bahasa Indonesia secara digital yang saat ini masih sangat rendah-hanya 0,6% dari konten internet di tahun 2023, kontras dengan bahasa Inggris yang mencapai 58,8%.

Peningkatan representasi bahasa Indonesia melalui pengembangan LLM dapat memberikan dampak signifikan pada potensi ekonomi digital Indonesia. Saat bahasa lokal dan dialek semakin banyak digunakan dalam komunikasi online, masyarakat dan perusahaan Indonesia akan lebih mudah berinteraksi secara digital tanpa hambatan bahasa. Ini akan menciptakan peluang baru dalam pasar digital, memungkinkan pelaku bisnis lokal menjangkau konsumen secara lebih luas dan mendorong pertumbuhan ekonomi berbasis teknologi.

Potensi dampak ekonomi dari pengembangan LLM ini diperkirakan mencapai $366 miliar (Rp5.539 triliun). Dengan potensi sebesar ini, Indonesia memiliki peluang besar memimpin transformasi digital di ASEAN, bahkan bisa melampaui negara-negara tetangga seperti Singapura, Thailand, Malaysia, Vietnam, dan Filipina.

Tantangan regulasi, risiko bias, dan disinformasi

AI, khususnya pengembangan LLM di Indonesia, menawarkan potensi ekonomi yang menggiurkan. Namun, di balik potensi ini, terdapat berbagai tantangan yang perlu dihadapi, salah satunya adalah regulasi perlindungan data. Regulasi ini sangat penting untuk memastikan bahwa data yang digunakan untuk melatih AI diperoleh secara sah dan dengan persetujuan pengguna.

Jika kita menilik kerangka hukum di Indonesia, hingga saat ini belum ada regulasi khusus mengenai AI. Meskipun sudah ada Undang-Undang Perlindungan Data Pribadi UU PDP, regulasi ini dinilai belum cukup untuk mengantisipasi dampak negatif dari pengembangan teknologi seperti LLM.

Sebagai contoh, Pasal 15 UU PDP membatasi akses individu terhadap data pribadinya dalam situasi tertentu, seperti untuk kepentingan keamanan nasional, penegakan hukum, atau penelitian ilmiah.

Namun, frasa "keamanan nasional" dalam pasal tersebut tidak memiliki definisi atau batasan yang jelas. Hal ini berpotensi menimbulkan risiko penyalahgunaan data oleh negara dengan dalih keamanan nasional. Oleh karena itu, regulasi yang lebih jelas sangat diperlukan untuk menyeimbangkan keterbukaan data dengan hak atas kepemilikan data. Penting untuk memastikan bahwa setiap individu memiliki kontrol penuh atas data mereka, termasuk hak untuk mengakses, menghapus, atau memodifikasi data sensitif.

Di sisi lain, hambatan dalam mewujudkan keterbukaan data, seperti kurangnya infrastruktur digital dan masalah interoperabilitas antar sektor, juga perlu segera diatasi.

Selain itu, potensi bias sosial atau diskriminasi dalam pengembangan LLM menjadi isu krusial yang patut diperhatikan. Studi ilmiah menunjukkan bahwa tujuh model LLM, termasuk ChatGPT dan LLaMA, menghasilkan bias gender dan ras yang cenderung mendiskriminasi perempuan dan orang kulit hitam.

Di Indonesia, potensi bias bahasa juga mungkin terjadi dalam pengembangan LLM yang menggunakan berbagai bahasa daerah. Mengingat keragaman kata dan makna dalam bahasa-bahasa nusantara, penting untuk memastikan ketersediaan data literatur bahasa, termasuk perubahan tren diksi, sebagai bahan pelatihan LLM lokal guna menghindari bias interpretasi dan respons model.

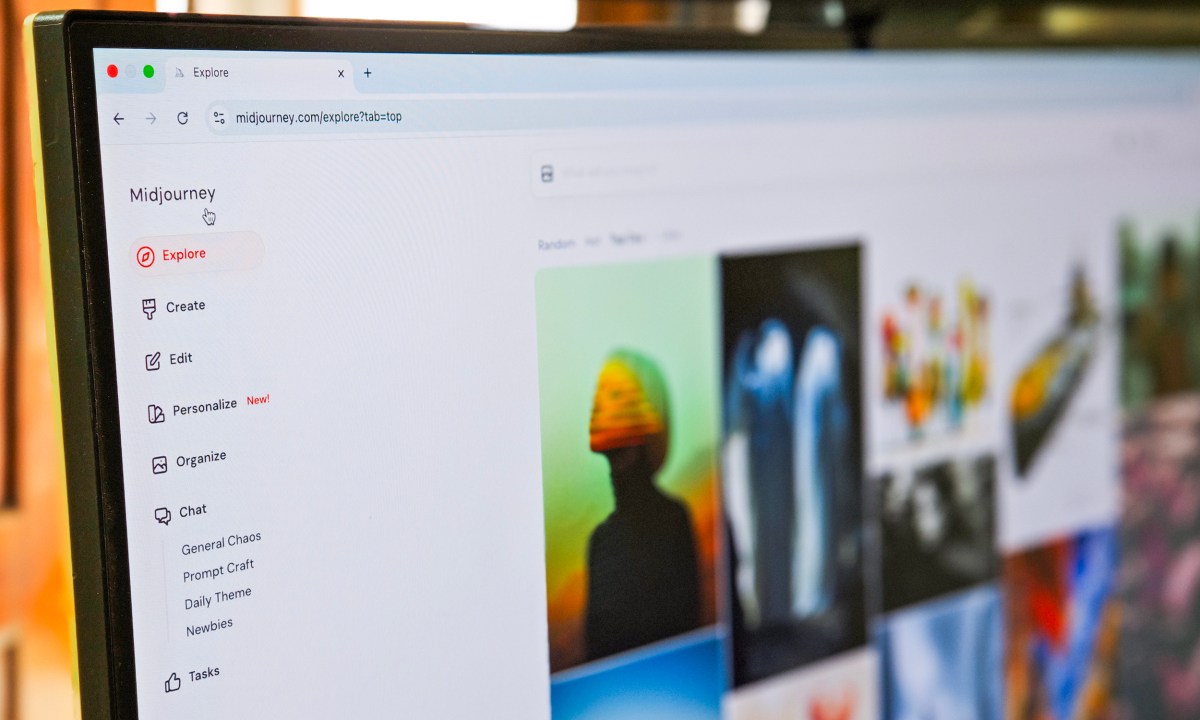

Pengembangan AI berbasis teks dengan kemampuan memproses dan menghasilkan informasi dalam skala besar juga rentan disalahgunkan untuk pembuatan konten yang memanipulasi realitas, seperti menyebarkan hoaks atau memanipulasi persepsi publik melalui konten palsu.

Dalam perkembangannya, LLM kini sudah bersifat multimodal-dapat memproses dan menghasilkan konten dalam berbagai modalitas, seperti teks, gambar, dan video. Ini membuat LLM dapat dimanfaatkan untuk penyebaran konten-konten manipulatif, salah satunya adalah video deepfake yang memanfaatkan aplikasi generative AI.

Contohnya adalah video pidato kampanye Presiden Suharto di Pemilu 2024 dan konten palsu Taylor Swift berkampanye untuk Presiden Donald Trump.

Menjembatani tantangan dan peluang

Indonesia saat ini berada di persimpangan dalam pengembangan AI berbasis bahasa. Di satu sisi, ada potensi besar untuk inovasi dan pertumbuhan ekonomi, tetapi di sisi lain, ada dilema etis dan risiko sosial yang harus dihadapi.

Oleh karena itu, pendekatan yang proaktif dan berpusat pada manusia sangat penting dalam mengarahkan perkembangan AI. Kita harus memastikan bahwa teknologi ini melayani manusia dan bukan sebaliknya teknologi yang mengendalikan hidup kita.

Dalam hal ini, regulasi berperan penting sebagai jaring pengaman, memastikan adanya transparansi (transparency), interpretabilitas (interpretability), dan keterjelasan (explainability). Aspek-aspek ini krusial untuk memahami bagaimana model LLM yang kompleks bekerja dan menghasilkan respons.

Namun, regulasi juga perlu tetap fleksibel. Aturan yang terlalu kaku, seperti AI Act di Uni Eropa, berpotensi menghambat inovasi. Pengaturan yang adaptif dan dinamis dibutuhkan untuk mendorong pengembangan AI yang bertanggung jawab tanpa menghalangi kemajuan industri.

Albert Jehoshua Rapha, Associate Researcher at Safer Internet Lab (SAIL) | Research assistant, KU Leuven

Artikel ini terbit pertama kali di The Conversation. Baca artikel sumber.